Qwen3.6はM1 Mac 8GBで動かない——2026年春版:今選ぶべきローカルLLM 4選

2026年3月に公開したQwen3.5 M1 Mac検証記事には、多くのアクセスをいただきました。あれから数ヶ月、ローカルLLMの世界は大きく動いています。

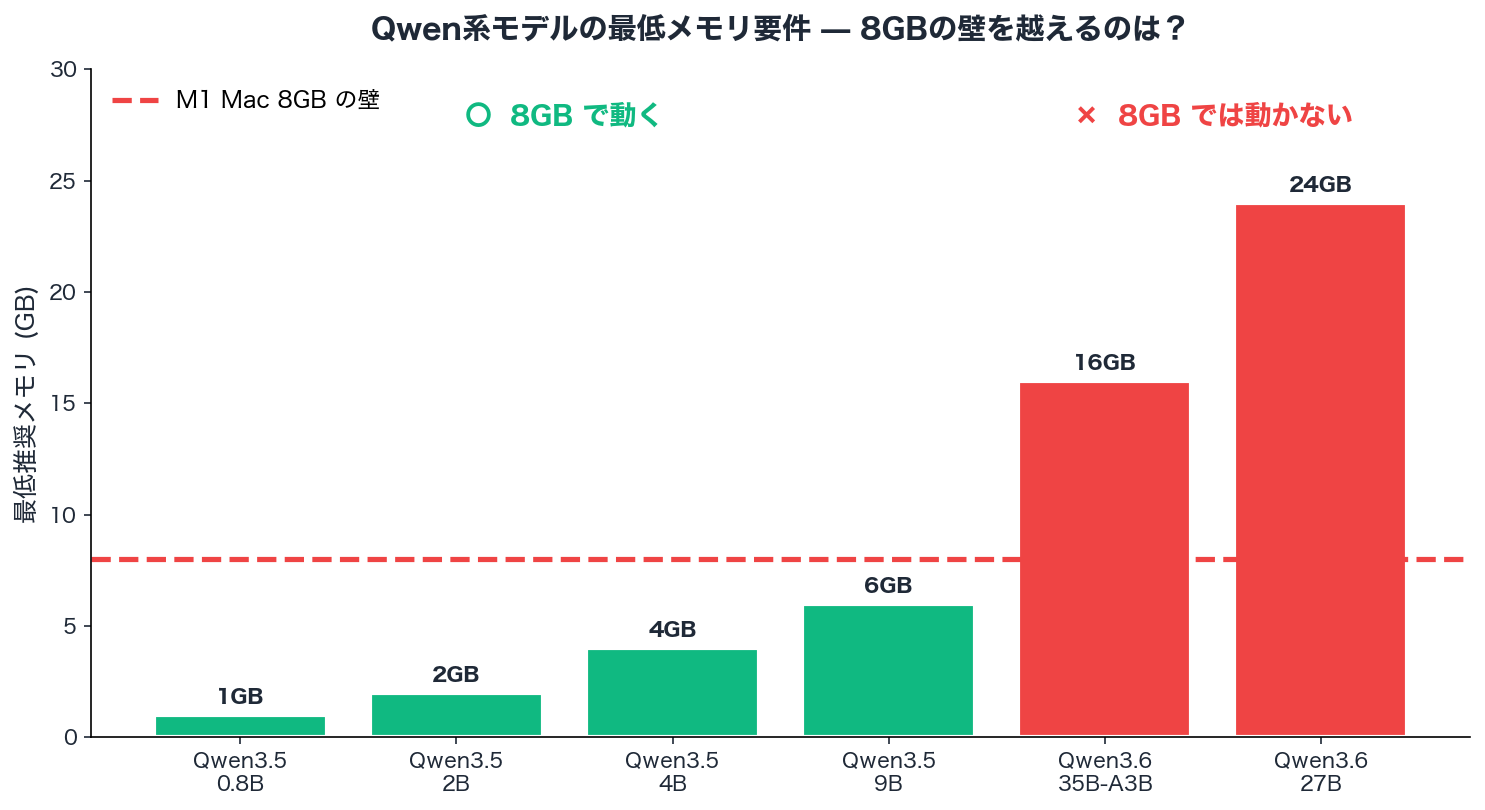

Qwen3.6がリリースされ、「次の検証を」と思って調べたところ、最初の壁にぶつかりました。Qwen3.6にはQwen3.5のような小型モデル(4B・9B)が存在しないのです。

この記事では、その理由を整理した上で、「今のM1 Mac 8GBで本当に使えるモデルはどれか」を4モデルで再検証します。

なぜQwen3.6は8GBで動かないのか

Qwen3.5は 0.8B / 2B / 4B / 9B という豊富なサイズ展開があり、8GBマシンでも4Bまで動作しました。

ところがQwen3.6のオープンウェイトモデルは以下の2種類のみです。

| モデル | サイズ | アーキテクチャ | 最低推奨メモリ |

|---|---|---|---|

| Qwen3.6-27B | 27B(dense) | 通常のDense + Vision | 24GB |

| Qwen3.6-35B-A3B | 35B(MoE) | Gated Delta Networks + sparse MoE | 16GB |

最小が27B——8GBでは物理的に不可能です。

なぜ小型モデルがないのか? Qwen3.6はマルチモーダル統合(早期融合)と201言語対応を標準搭載しており、モデル構造の最小単位がそれだけ大きくなっています。Alibabが小規模ユーザー向けには引き続きQwen3.5系を推奨している、という設計判断です。

検証環境

| 項目 | スペック |

|---|---|

| マシン | MacBook Pro (2020) |

| チップ | Apple M1 |

| メモリ | 8GB(ユニファイドメモリ) |

| OS | macOS Sequoia |

| Ollama | v0.23.2 |

| 検証日 | 2026-05-12 |

前回(Qwen3.5検証)との変化点: Ollama が v0.17.6 → v0.23.2 に更新。v0.22.0でMLXバックエンドが本格稼働しており、Apple Siliconでの推論効率が向上しています。

検証対象モデル

| モデル | ファイルサイズ | 開発元 | 特徴 |

|---|---|---|---|

alibayram/smollm3:latest | 1.9GB | HuggingFace | SmolLM3。超軽量が売り |

gemma3:4b | 3.3GB | Gemma3シリーズの小型モデル | |

qwen3.5:4b | 3.4GB | Alibaba | 前回検証済み。今回の比較ベースライン |

gemma4:e2b | 7.2GB | Gemma4最小モデル(E2B = Efficient 2B) |

検証方法

Qwen3.5記事と同じ3プロンプトを使用し、公平な比較を担保します。

| テスト | プロンプト | 評価ポイント |

|---|---|---|

| 日本語要約 | 「量子コンピュータとは何か、小学生にもわかるように3行で説明してください」 | 日本語の自然さ・指示遵守 |

| コード生成 | 「PythonでFizzBuzzを書いてください。コードのみ出力してください。」 | コードの正確性 |

| 論理推論 | 「東京の人口が減少し続けた場合、最も影響を受ける産業を3つ挙げ、理由を述べてください」 | 論理性・構成力 |

速度はOllama REST APIで計測(eval_count ÷ eval_duration)。

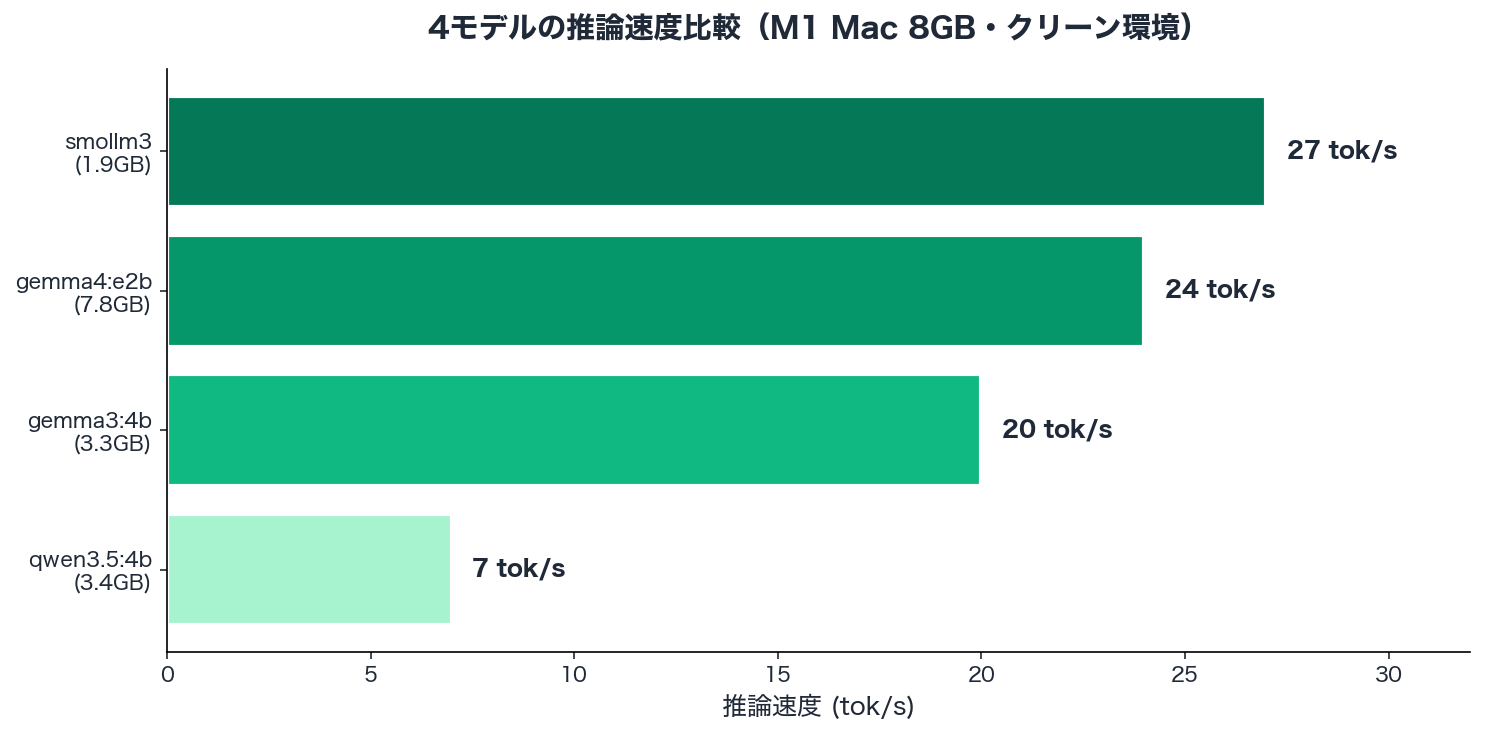

検証結果

パフォーマンス比較表

計測条件: Brave・Claude デスクトップ等を全て終了したクリーン環境で計測。

| モデル | メモリ使用量 | CPU/GPU比率 | 推論速度(平均) | 体感 |

|---|---|---|---|---|

alibayram/smollm3 | ~2GB | ~100% GPU | 27 tok/s | 最速・快適 |

gemma4:e2b | 7.8GB | 75% CPU / 25% GPU | 24 tok/s | 快適(クリーン環境限定) |

gemma3:4b | ~4GB | バランス | 20 tok/s | 快適 |

qwen3.5:4b | 6.0GB | 33% GPU / 67% CPU | 7 tok/s | やや待つが実用範囲 |

各プロンプト別の速度:

| モデル | 日本語要約 | FizzBuzz | 論理推論 |

|---|---|---|---|

smollm3 | 26.3 tok/s | 27.2 tok/s | 27.7 tok/s |

gemma4:e2b | 24.2 tok/s | 24.3 tok/s | 24.0 tok/s |

gemma3:4b | 20.0 tok/s | 20.1 tok/s | 19.9 tok/s |

qwen3.5:4b | 6.3 tok/s | 7.2 tok/s | 7.3 tok/s |

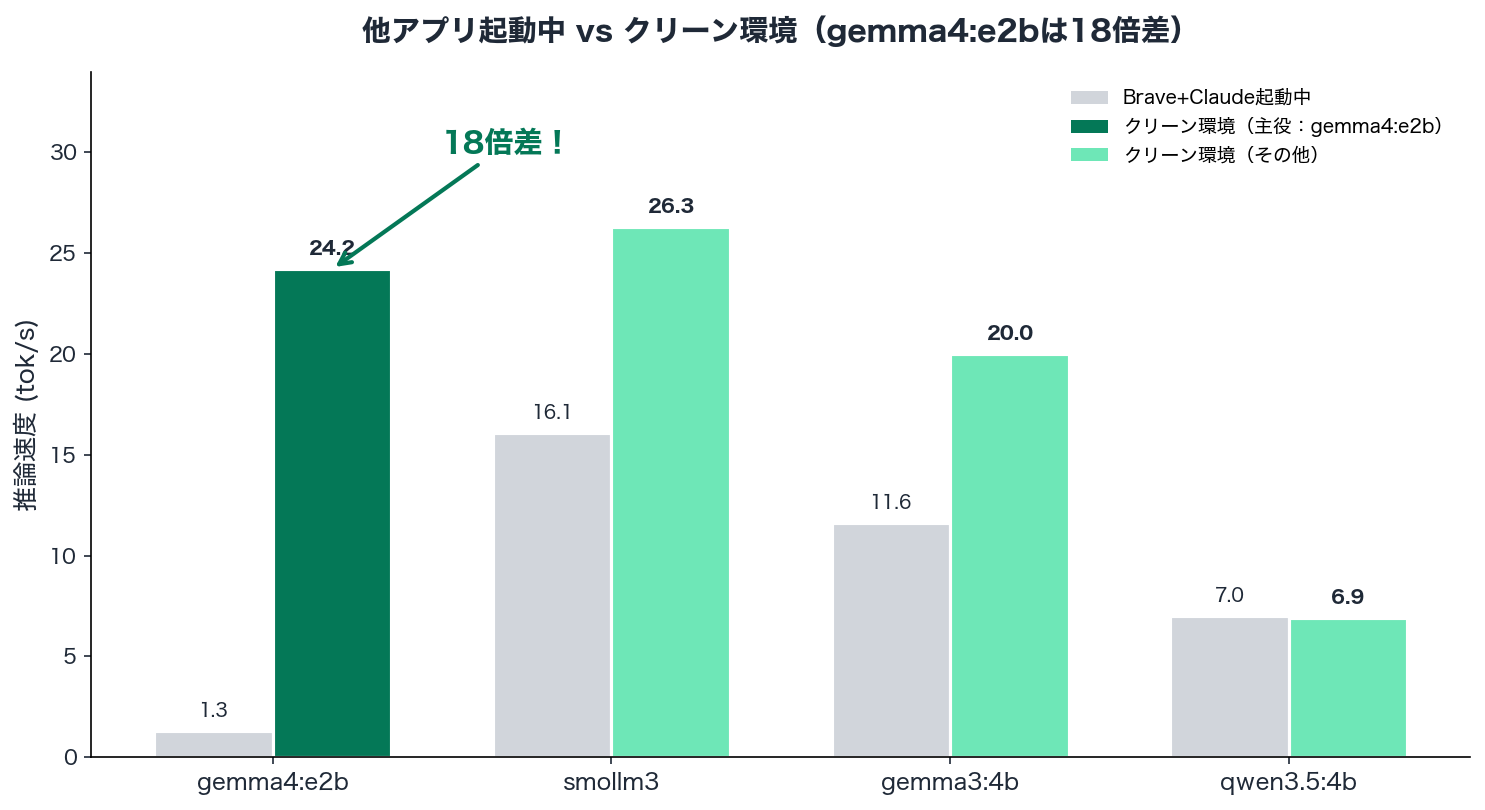

⚠️ 他アプリ起動中は速度が急落します(後述)。

モデルごとの詳細レポート

alibayram/smollm3 — 速度は最速、日本語精度はやや不安定

日本語要約の応答(26.3 tok/s):

量子コンピュータは、通常のコンピュータよりも小さな粒子の状態を利用することで計算が高速に行える仕組みです。例えば、1つの電子を使って2つの情報を同時に処理できるという特性があります。これにより、大規模な計算問題を解くのに時間をかけることができます。

3行の指示を守れず1行になっており、「時間をかけることができます」は意味的に逆(速くなるはず)。内容に不正確さが残ります。

FizzBuzz(27.2 tok/s): 完璧に正しいコードを出力。

論理推論(27.7 tok/s): 飲食業・娯楽・ビジネスサービスを挙げ、論理は通る。ただし分析の深さはgemma3:4bより浅い。

総評: 4モデル中最速の27 tok/s。コード生成や英語タスクには十分実用的。日本語の指示遵守・精度は4モデル中最下位で、重要な業務用途には向かない。

gemma3:4b — 品質・速度・安定性のバランスが最良

日本語要約の応答(20.0 tok/s):

量子コンピュータは、普通のコンピュータとは違う、とても不思議な計算機です。 「0」と「1」を同時に使える「量子ビット」を使うので、普通のコンピュータでは答えが出ない問題を解ける可能性があります。 まだ開発途中で、将来、医療や材料開発など、色々な分野で活躍することが期待されています。

3行の指示を守り、小学生向けの表現も自然。4モデル中、指示遵守と品質のバランスが最も安定しています。

FizzBuzz(20.1 tok/s): 関数化されたきれいなコードを出力。ロジックも正確。

論理推論(19.9 tok/s): 不動産業界・サービス業(飲食・小売)を、東京固有の経済構造と絡めて詳述。構成力が高い。

総評: クリーン環境で20 tok/sを達成。日本語品質・指示遵守・速度のすべてでバランスが取れており、他アプリと並用しながらローカルLLMを使いたい場合の最推奨モデル。

qwen3.5:4b — 品質は高いが速度は他アプリの影響を受けない代わりに遅い

日本語要約の応答(6.3 tok/s):

普通のコンピュータは「0」か「1」のどちらかしか考えない。 量子コンピュータは「0」も「1」も「同時に」考えます。 これが力になって、とても難しい問題をすばやく解くことができます。

3行遵守、簡潔で正確。比喩は少ないが内容は明快。

FizzBuzz(7.2 tok/s): 完璧に正しいコードを出力。

論理推論(7.3 tok/s): 不動産業・小売商業を、空き家問題・消費人口減少という具体的な角度から詳述。4モデル中最も論理構成が丁寧。

速度の特性: クリーン環境でも6〜7 tok/sで変化なし。これは6GBのメモリ占有と67% CPUオフロードが固定のため、他アプリの影響を受けにくい反面、もともと遅い。

総評: Difyとの接続実績があり品質も高い。ただしクリーン環境でも7 tok/sと4モデル中最遅。gemma3:4bへの乗り換えを推奨。

gemma4:e2b — 「使える」か「使えない」かはメモリ次第

gemma4:e2bは今回の検証で最も劇的な結果を示したモデルです。

ollama ps で確認した実態:

NAME SIZE PROCESSOR

gemma4:e2b 7.8 GB 75%/25% CPU/GPU

7.2GBのモデルが7.8GBを消費し、GPUに25%しか乗らず75%がCPUに押し出されます。この比率はクリーン環境でも変わりません。

しかし、速度はメモリの空き状況で天と地ほど変わります。

| 計測条件 | 推論速度 | 日本語の応答時間 |

|---|---|---|

| Brave + Claude起動中(空きメモリ 60MB) | 1.3 tok/s | 8分15秒 |

| Brave + Claude終了後(空きメモリ 210MB→) | 24.2 tok/s | 約20秒 |

差は18倍。原因はスワップです。8GBのRAMにgemma4:e2b(7.8GB)+他アプリ(計7GB超)を詰め込んだ結果、OSが激しくスワップを繰り返し、速度が壊滅的になっていました。

応答品質は4モデル中最高水準です。

日本語要約:

普通のコンピュータが「0」か「1」しか考えられないのに対し、量子コンピュータは「0」と「1」を同時に持てる不思議な力を使います。 この力のおかげで、とても複雑な問題も、たくさんの答えを同時に試して、一気に解くことができます。 まるで魔法みたいに、今まで解けなかった難問をあっという間に解決してくれる、すごい計算機です。

FizzBuzz:完璧に正しいコードを出力(24.3 tok/s)。

論理推論:不動産・建設業/オフィス・サービス産業/小売・消費関連産業を、それぞれ東京固有の経済構造と絡めて詳述。4モデル中最も分析が深い(24.0 tok/s)。

総評: クリーン環境(ほかのアプリを閉じた状態)なら24 tok/sで最速かつ最高品質。ただし**「ローカルLLM専用機として使う」覚悟が必要**。ブラウザやデスクトップアプリと並用すると即座に破綻します。8GBマシンでgemma4:e2bを選ぶなら、使用中は他アプリをすべて閉じることが前提条件です。

他アプリ起動中 vs クリーン環境:速度への影響

今回の検証で最も重要な発見は、同じモデルでも計測環境で速度が最大18倍変わることでした。

| モデル | Brave+Claude起動中 | クリーン環境 | 改善率 |

|---|---|---|---|

gemma4:e2b | 1.3 tok/s | 24.2 tok/s | +18倍 |

smollm3 | 16.1 tok/s | 26.3 tok/s | +1.6倍 |

gemma3:4b | 11.6 tok/s | 20.0 tok/s | +1.7倍 |

qwen3.5:4b | 7.0 tok/s | 6.9 tok/s | ほぼ変化なし |

Brave(複数タブ)+ Claude デスクトップが起動中、システムの空きメモリはわずか 60MB でした。gemma4:e2bの7.8GBを足すと合計15GB超を8GBへ詰め込む状態となり、OSが激しくスワップを繰り返した結果が1.3 tok/sです。

qwen3.5:4bだけが影響を受けていないのは、もともと67% CPUオフロード固定で7 tok/sが上限のため、スワップ追加ペナルティが相対的に小さいためです。

前回(Qwen3.5検証)との比較

| 指標 | qwen3.5:4b(前回) | gemma3:4b(今回推奨) | 変化 |

|---|---|---|---|

| 推論速度(クリーン環境) | 7 tok/s | 20 tok/s | +186% |

| メモリ使用量 | 6.0GB | ~4GB | -33% |

| 日本語3行指示遵守 | ✅ | ✅ | 同等 |

| FizzBuzz正解 | ✅ | ✅ | 同等 |

| ファイルサイズ | 3.4GB | 3.3GB | ほぼ同等 |

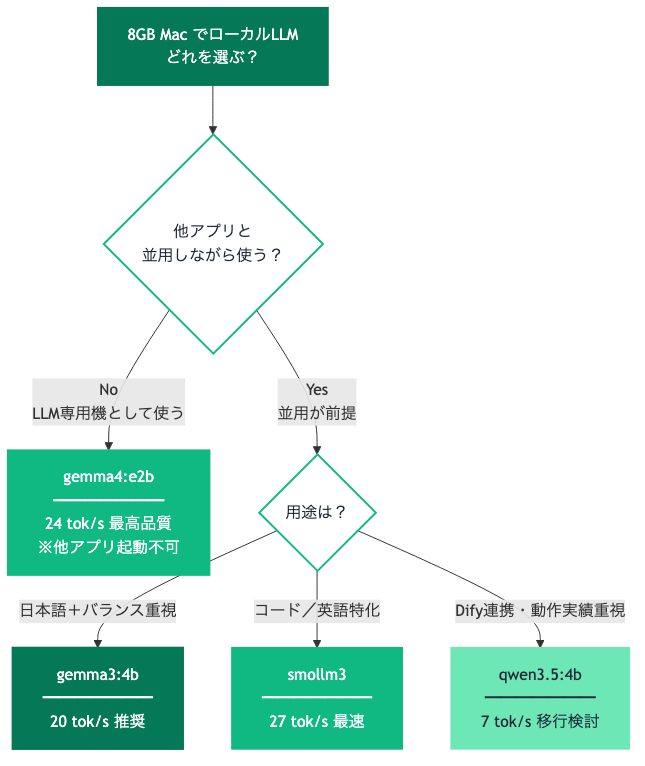

結論:2026年春、M1 Mac 8GBでのベストチョイス

| 用途 | おすすめモデル | 速度 | 理由 |

|---|---|---|---|

| LLM専用で使う(他アプリ全閉じ) | gemma4:e2b | 24 tok/s | 最高品質+高速。ただし他アプリと共存不可 |

| 他アプリと並用しながら使う | gemma3:4b | 20 tok/s | 品質・速度・安定性のバランスが最良 |

| コード生成・英語タスク特化 | smollm3 | 27 tok/s | 最速だが日本語精度は低め |

| Dify連携・動作実績重視 | qwen3.5:4b | 7 tok/s | 前回検証済み。gemma3:4bへの移行を推奨 |

8GBマシンの鉄則:速度を決めるのはモデルの大きさではなく、空きメモリの量。

gemma4:e2bはクリーン環境で24 tok/sを出しましたが、Braveを開いた瞬間に1 tok/s台へ急落します。「何と並べて使うか」を先に決めてからモデルを選ぶのが8GBマシン攻略の鍵です。

補足:Qwen3.6を使いたい場合

8GBマシンではローカル実行は諦め、APIで使うのが現実的です。

# OpenAI互換APIでQwen3.6-Plusを呼ぶ例(Alibaba Cloud)

from openai import OpenAI

client = OpenAI(

api_key="YOUR_DASHSCOPE_API_KEY",

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1"

)

response = client.chat.completions.create(

model="qwen3.6-plus",

messages=[{"role": "user", "content": "量子コンピュータとは"}]

)DifyはOpenAI互換APIに対応しているため、base_urlとモデル名を変えるだけでQwen3.6-PlusをDifyのバックエンドとして利用できます。

まとめ

- Qwen3.6はM1 Mac 8GBでは動かない。最小モデルが27Bで、8GBの壁は越えられない。

- gemma4:e2bはクリーン環境なら最速(24 tok/s)。ただし他アプリ起動中はスワップで1 tok/s台へ急落する。

- 安定して他作業と並用するならgemma3:4b。11 tok/sで品質◎、メモリも余裕がある。

- 8GBマシンの性能はモデルより「空きメモリ」が決める。これが今回の最大の発見。

- Qwen3.6を使うならAPI。DifyのOpenAI互換設定なら数分で繋がる。

関連記事

- Qwen3.5の小型モデルをM1 Mac(8GB)で実機検証:どのサイズまで快適に動くのか — 本記事のベースライン