1. はじめに

大規模言語モデル(LLM)は幅広いタスクに活用されるようになっています。その背景には、LLMが人間に匹敵するような計画および推論の能力を獲得し、多くのタスクを自律的に解決するAIエージェントとして活用されてきたことが挙げられます。

AIエージェント ユーザに代わって、目標達成のための最適な手段を自律的に選択し、タスクを遂行するAI技術のこと

近年は、単一のエージェントを組み合わせたLLMベースのマルチエージェント(LLM-MA)の活用によって、複雑な問題解決やシミュレーションにおいて大きな進展を遂げています。 この記事では、参考論文「Large Language Model based Multi-Agents: A Survey of Progress and Challenges」をもとに、LLM-MAの概要を解説します。

https://arxiv.org/html/2402.01680v2

対象者 論文を読む時間はないけれど、LLM-MAに関して、次のようなことを知りたい方を対象にしています。

- どのような仕組みで機能しているのか?

- どのような分野に応用されているのか?

- どのような課題があるのか?

本記事の構成

| セクション | 概要 |

|---|---|

| 2. シングルエージェントとの違い | 単一のエージェントとの対比によって、LLM-MAの特徴を説明 |

| 3. システムの全体像 | LLM-MAシステムのアーキテクチャを4つの側面に分解し、どのように現実のタスクに取り組んでいるのかを解説 |

| 4. 応用分野 | 「問題解決」と「シミュレーション」の2つに分類して、どのような分野に応用されているのかを紹介 |

| 5. 代表的なフレームワーク | 今後の研究や活用を見据えて、代表的なLLM-MAフレームワークを紹介 |

| 6. 課題 | LLM-MAが現在抱える重要課題を指摘 |

2. シングルエージェントとの違い

LLM-MAは、シングルエージェントにはない、エージェント同士のコミュニケーションおよび協働によって、より動的かつ複雑なタスクに取り組めるようになっています。

動的なタスク タスク遂行の最中に状況や前提が変わるタスクのこと

2-1. シングルエージェントの仕組み

シングルエージェントは次の3つの主要な能力によって機能します。

| 意思決定の思考(Decision-making Thought) | ユーザのプロンプト(指示)から判断し、タスクの分解や過去の経験からの学習を通じて、複雑なタスクに対してより良い意思決定を行う能力 |

|---|---|

| 意思決定の思考(Decision-making Thought) | ユーザのプロンプト(指示)から判断し、タスクの分解や過去の経験からの学習を通じて、複雑なタスクに対してより良い意思決定を行う能力 |

| ツール利用(Tool-use) | 外部のツールやリソース(Web検索、コードの実行など)を活用し、多様で動的なタスクを実行する能力 |

| 記憶(Memory) | 短期記憶としてプロンプト、長期記憶として外部データベースを参照することによって、長期間にわたって一貫した文脈でタスクを実行する能力 |

2-2. LLM-MAの特徴

シングルエージェントと比較した場合のLLM-MAの特徴は、異なる役割のエージェントが相互作用(コミュニケーションおよび協働)を通じて、集合的な意思決定プロセスを経るということです。

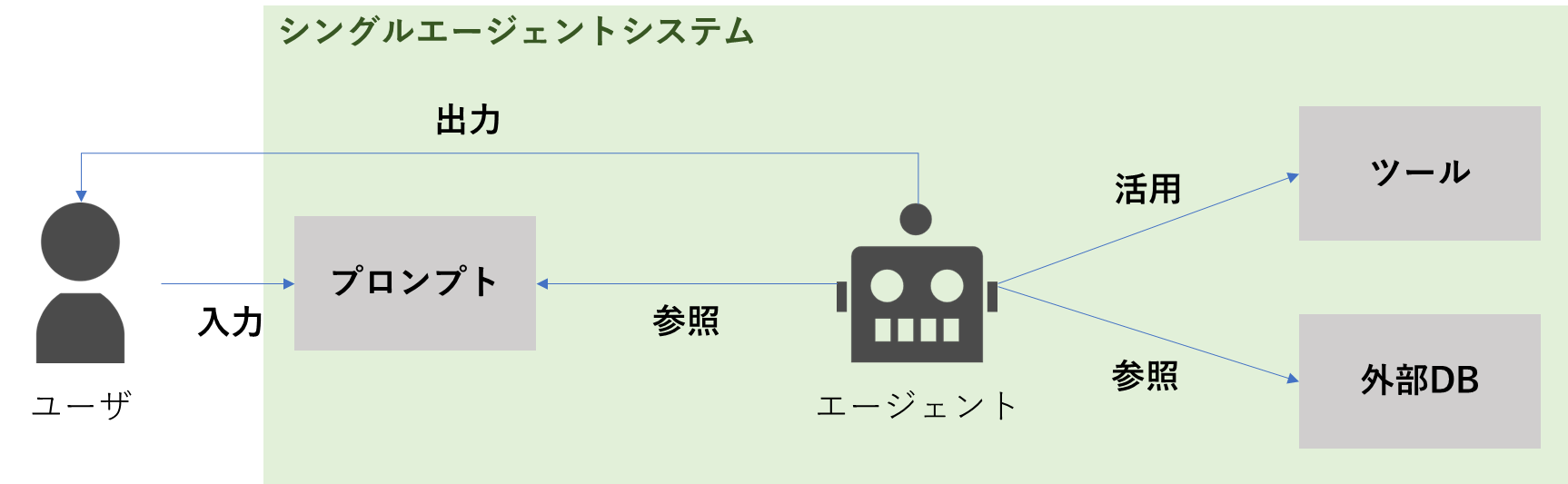

- シングルエージェント

シングルエージェントシステムのイメージ(筆者作成)

シングルエージェントシステムのイメージ(筆者作成)

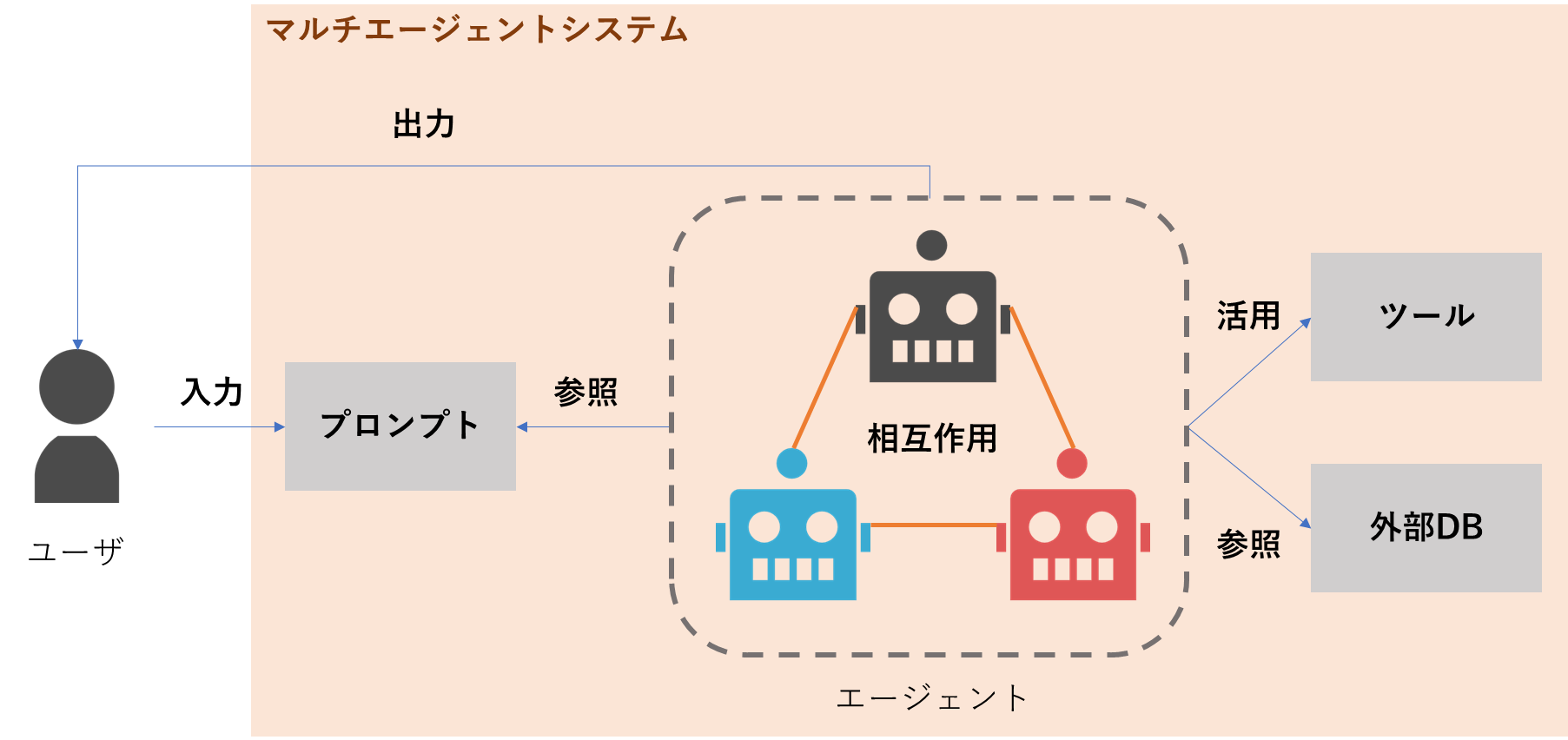

- マルチエージェント

マルチエージェントシステムのイメージ(筆者作成)

マルチエージェントシステムのイメージ(筆者作成)

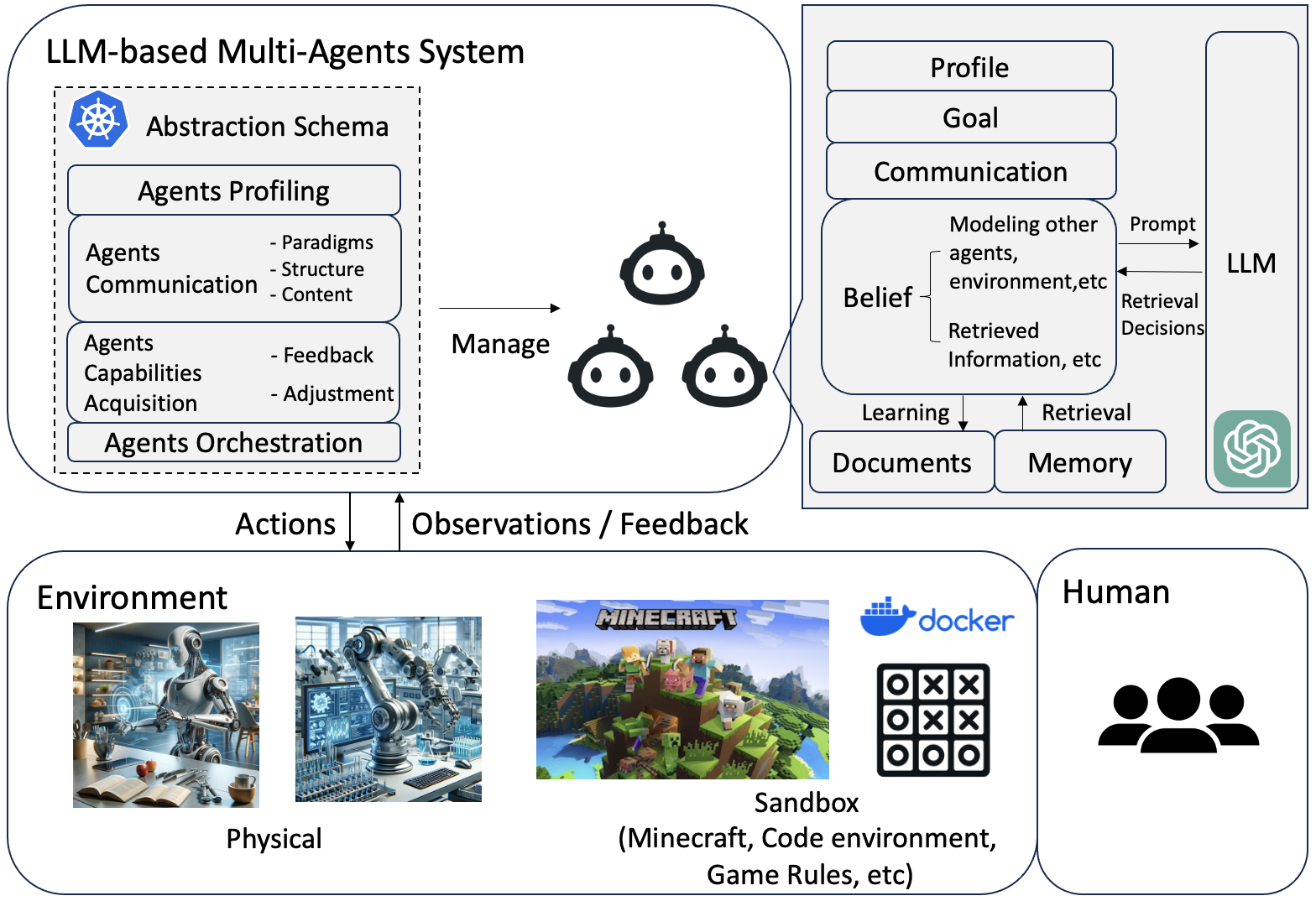

3. システムの全体像

LLM-MAシステムが問題解決する際の運用フレームワークは、下記の4つの主要な要素に分けられます。

-

エージェントと環境との間のインターフェース

-

エージェントのプロファイリング

-

エージェント間のコミュニケーション

-

エージェントの能力獲得

LLM-MAシステムの一般的なアーキテクチャ

LLM-MAシステムの一般的なアーキテクチャ

3-1. エージェントと環境との間のインターフェース

エージェントと環境との間のインターフェースとは、エージェントが環境をどのように知覚し相互作用するかを指します。LLMベースのエージェントは環境を知覚し行動し、その環境がエージェントのふるまいや意思決定に影響を及ぼします。

環境とは、エージェントシステムが配置され相互作用する特定の文脈や設定を指しています。具体的には、ソフトウェア開発、ゲーム、金融市場、社会行動モデリングなどの多様な領域を含みます。

LLM-MAにおけるインターフェース(3分類)

| 分類 | 概要 | 具体例 |

|---|---|---|

| サンドボックス(Sandbox) | 人手で構築されたシミュレーションまたは仮想環境。エージェントが自由度高く相互作用し、さまざまな行動や戦略を試せる。 | ソフトウェア開発、ゲーム |

| 物理(Physical) | 実世界の環境。エージェントは物理的実体と相互作用し、現実の物理法則や制約に従う。 | ロボット |

| なし(None) | 特定の外部環境が存在せず、エージェントが環境と相互作用しないシナリオ。 | エージェント間のディベート |

3-2. エージェントのプロファイリング

LLM-MAシステムにおいて、エージェントは特性・行動・技能によって定義され、特定の目標に整合するように調整されます。このようなエージェントの役割設定がプロファイリングです。

| 概要 | 具体例(例:エンジニア) | |

|---|---|---|

| 特性(Traits) | どんなタイプか? | 速度 > 完璧主義 |

| 行動(Actions) | 何ができるか?(実際にできる操作) | 設計→実装→単体テスト 外部API/DBの呼び出し プルリクエストの作成 |

| 技能(Skills) | どんなスキルを持つか? | 設計分解 コード生成 デバッグ |

プロファイリング手法(3類型)

| 類型 | 設定者 | 概要・特徴 |

|---|---|---|

| 事前定義(Pre-Defined) | 人 | テキストでプロファイルを明示。 制御性・再現性に優れる一方、設計コストがかかる。 |

| モデル生成(Model-Generated) | LLM | プロンプトをもとにLLMがプロファイルを生成。 設計が早く発想が広がる一方、不適切な設計になるリスクがある。 |

| データ起点(Data-Derived) | 人 + データ | データを集計・分析して、それをもとにプロファイルを作成。 環境への適合性が高く効果が出やすい一方、データの整備などにコストがかかる。 |

実務的には、1つだけの手法ではなく、それぞれの特徴を生かせるようにハイブリッドが採用されることも多いです。

3-3. エージェント間のコミュニケーション

LLM-MAシステムにおけるエージェント間のコミュニケーションは、集合的な意思決定を支える中核的なインフラです。コミュニケーションは3つの観点に切り分けられます。

-

コミュニケーション・パラダイム:エージェント同士のやり取りの方式

-

コミュニケーション構造:エージェント間のネットワークのアーキテクチャ

-

コミュニケーション内容:エージェント間でやり取りされる情報の中身

コミュニケーション・パラダイム

| 協調(Cooperative) | 共有の目標に向けて協働し、情報を交換して集合的な意思決定を実現。 |

|---|---|

| 協調(Cooperative) | 共有の目標に向けて協働し、情報を交換して集合的な意思決定を実現。 |

| 討論(Debate) | 各エージェントが自らの見解や解法を提示・擁護し、他者の提案を批判的に検討。 |

| 競合(Competitive) | 各エージェントが互いに相反し得る目標に向けて行動。 |

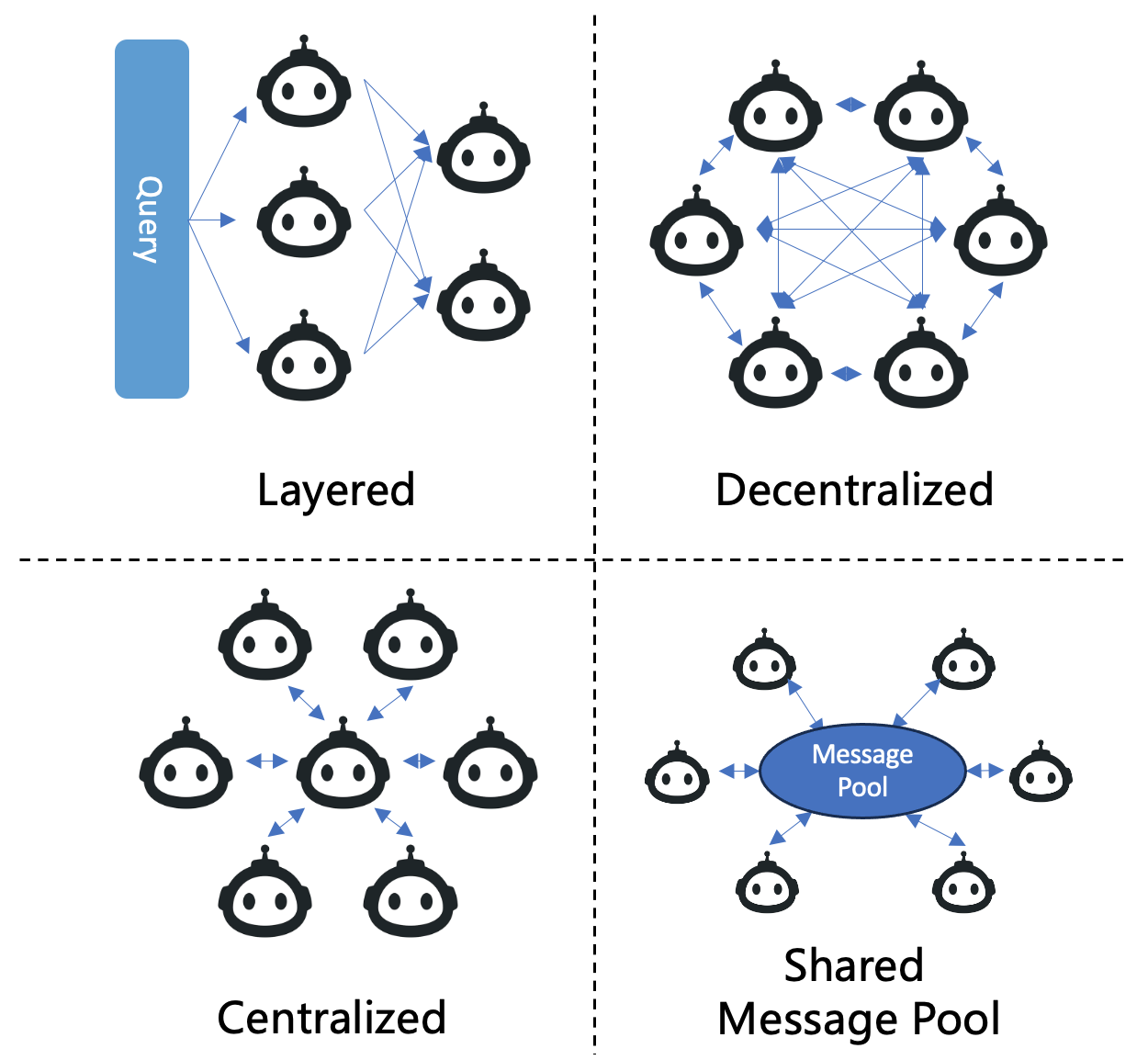

コミュニケーション構造

| 階層型(Layered) | 階層的に構成され、各層のエージェントは固有の役割を持ち、主に同層または隣接層とやり取りする。 |

|---|---|

| 階層型(Layered) | 階層的に構成され、各層のエージェントは固有の役割を持ち、主に同層または隣接層とやり取りする。 |

| 分散型(Decentralized) | ピアツーピアで動作し、エージェント同士が直接通信する。世界シミュレーション系の応用で一般的。 |

| 集中型(Centralized) | 中央ノード(エージェントまたはその集団)が通信を調整し、他のエージェントは主としてこの中央ノードを介して相互作用する。 |

| 共有メッセージプール(Shared Message Pool) | 共有プールにメッセージを発行(publish)し、各エージェントが自らのプロファイルに基づいて定期的に取得(subscribe)することで、通信効率を高める。 |

コミュニケーション構造の4類型

コミュニケーション構造の4類型

コミュニケーション内容 LLM-MAシステムでは、コミュニケーション内容は通常テキストの形をとります。その内容は応用分野によって大きく異なります。

- 具体例

- ソフトウェア開発:エージェント同士がコード片をやり取りする

- 人狼ゲームのようなシミュレーション:分析・疑念・戦略などが議論される

3-4. エージェントの能力獲得

エージェントの能力獲得は、LLM-MAにおいてエージェントが学習し動的に進化できるようにする重要なプロセスです。エージェントが能力を向上するためには、フィードバックを受け、エージェント自ら複雑な問題へ適応する必要があります。

フィードバック フィードバックとは、エージェントが自らの行動の結果に受け取る情報です。行動の潜在的影響を学習し、複雑かつ動的なタスクに適応するのに役立ちます。 フィードバックはその出所に基づき、4つに分類されます。

| 環境からのフィードバック | 実世界または仮想環境からのフィードバック。 問題解決シナリオの大半で一般的。 |

|---|---|

| 環境からのフィードバック | 実世界または仮想環境からのフィードバック。 問題解決シナリオの大半で一般的。 |

| エージェント間の相互作用からのフィードバック | 他のエージェントの判断やエージェント間のコミュニケーションから得られるフィードバック。 問題解決シナリオ(例:ディベート)では、エージェントは相互のやり取りを通じて、結果を非判定に評価・洗練することを学ぶ。 世界シミュレーション(例:人狼ゲーム)では、他のエージェントとの過去の相互作用に基づいて戦略を洗練する。 |

| 人間からのフィードバック | 人間から直接与えられるフィードバック。 LLM-MAシステムを人間の価値観や嗜好に合わせるために不可欠。 |

| なし | エージェントにフィードバックが与えられないこともある。 例えば、エージェントの計画能力よりもシミュレーション結果の分析に焦点を当てる世界シミュレーション研究で見られる。 |

複雑な問題への適応 LLM-MAのエージェントは、3つの方法で問題に適応します。

| 記憶(Memory) | 多くのLLM-MAシステムは、エージェントは過去の相互作用やフィードバックから得た情報をメモリに保存し、行動時に関連する有益な記憶を活用する。 |

|---|---|

| 記憶(Memory) | 多くのLLM-MAシステムは、エージェントは過去の相互作用やフィードバックから得た情報をメモリに保存し、行動時に関連する有益な記憶を活用する。 |

| 自己進化(Self-Evolution) | エージェントは、フィードバックやコミュニケーションに基づき、自己訓練によって自己進化する。 メモリのように過去の記録に基づいて行動を決めるだけでなく、プロファイルや目標そのものの自律的な調整ができる。 |

| 動的生成(Dynamic Generation) | 状況によっては、システム実行時に新しいエージェントをその場で生成できる。 これによって、システムはスケールしつつ効果的に適応でき、現在のニーズや課題に特化したエージェントを導入できる。 |

4. 応用分野

LLM-MAシステムの応用分野は、問題解決と世界シミュレーションに大別されます。

論文でも指摘されているとおり、日進月歩で新しい応用分野が現れていることには注意が必要です。ここでは、あくまで論文で紹介されている分野をまとめています。

4-1. 問題解決

| ソフトウェア開発 | LLM-MAシステムが複数の異なる役割(プロダクトマネジャー、プログラマ、テスターなど)を模倣し、協働して対処するように設計される。 |

|---|---|

| ソフトウェア開発 | LLM-MAシステムが複数の異なる役割(プロダクトマネジャー、プログラマ、テスターなど)を模倣し、協働して対処するように設計される。 |

| エンボディドエージェント | エンボディド(身体性)エージェントの応用では、異なる能力を持つ複数のロボットが協調して、倉庫管理のような現実世界の計画・操作タスクを行う。 LLM-MA は能力の異なるロボットをモデル化し、協働させて物理的タスクを解かせるのに用いられる。 |

| 科学実験 | マルチエージェントをチームとして編成し、科学実験を遂行する。 ここでは、科学実験の高コストや LLM エージェントのハルシネーションのため、人間による監督が極めて重要である。人間の専門家は、エージェントからの情報を統合し、エージェントへフィードバックを与える。 |

| 科学的なディベート | MMLUや数学問題といったタスクにおいて、科学的討論のシナリオにも設定できる。 各エージェントがまず独自の分析を提示し、その後共同の討論プロセスを行う。複数ラウンドの討論を通じて、エージェントは1つの解へと収束する。 |

**ハルシネーション(幻覚)**とは、生成AIが事実に基づかない情報や実際には存在しない情報を生成する現象です。まるで真実であるかのようにもっともらしく提示されることから「ハルシネーション(幻覚)」と言われます。

MMLU (Massive Multitask Language Understanding) とは、自然言語処理(NLP)分野で広く用いられるAIモデルの性能評価指標のひとつです。多様な学問分野から大量の問題を用意し、モデルの幅広い知識を推論能力を測定します。

4-2. 世界シミュレーション

| 社会シミュレーション | LLM-MAを用いて社会的行動を模擬し、仮想空間やコミュニティに現実的な社会現象を再現する。 固有のプロファイルを持つエージェントが活発にコミュニケーションすることで、社会科学の詳細分析に資する豊富な行動データが生成される。 |

|---|---|

| 社会シミュレーション | LLM-MAを用いて社会的行動を模擬し、仮想空間やコミュニティに現実的な社会現象を再現する。 固有のプロファイルを持つエージェントが活発にコミュニケーションすることで、社会科学の詳細分析に資する豊富な行動データが生成される。 |

| ゲーム | エージェントがゲーム内で多様な役割を担うことにより、人間同士のやり取りを近似したシステムを構築できる。 ゲーム理論に関する多様な仮説(推論、協力、説得、欺瞞、リーダーシップなど)の検証に適する。 |

| 心理学 | 心理シミュレーション研究では、複数エージェントを用いて、さまざまな特性や思考過程を持つ人間を模擬する。 **社会シミュレーションと異なる手法 **心理学の実験をエージェントに直接適用する。多様な行動を観察・分析し、各エージェントは互いに相互作用せず独立に動作する。 **社会シミュレーションに近い手法 **複数エージェントが相互作用・通信し、心理学理論を適用して創発的な行動パターンを理解・分析する。対人ダイナミクスや集団行動の研究、個々の心理特性が集合的行動に与える影響の洞察が得られる。 |

| 経済 | LLM-MAは、人間の暗黙の計算モデルとして機能し得るため、経済・金融取引環境のシミュレーションに用いられる。 エージェントに報酬、情報、事前に定められた選好を設定して、経済・金融文脈での行動を探る。マクロ経済活動、情報市場、金融取引、仮想タウンなど幅広い経済シナリオへ応用される。 |

| レコメンドシステム | LLM-MA の使い方は心理学に近い。認知過程やパーソナリティといった内的要因やその他の外的要因を考慮するためである。アプローチは主に2つ。 アプローチ① 多様な特性を持つ複数の LLM エージェントにアイテムを提示し、エージェントごとの嗜好を統計的に評価する。 アプローチ② ユーザとアイテムの双方をエージェントと見なし、ユーザとアイテムとの相互作用をコミュニケーションとして扱い、嗜好の伝播をシミュレートする。 |

| 政策立案 | ゲームや経済のシミュレーションと同様に、政策立案には現実的で動的な複雑問題に対する意思決定能力が求められる。 仮想政府や政策のコミュニティへの影響をシミュレートすることで、政策形成のプロセスとその影響に関する有益な示唆を与え、政策立案者が結果を予見する助けとなる。 |

| 疫病伝播シミュレーション | 社会シミュレーションの能力を活用して、感染症の伝播シミュレーションにも用いられる。 症例数の増加時の検疫や隔離、人間の応答行動などをシミュレートする。 |

5. 代表的なフレームワーク

今後の研究や活用を見据えて、オープンソースのLLM-MAフレームワークを3つ紹介します。

| フレームワーク | 概要 | 出典 |

|---|---|---|

| MetaGPT | 人間のワークフローをLLM-MAの運用に組み込むことで、複雑タスクでしばしば生じるハルシネーション問題を低減する。 標準作業手順(SOP: Standard Operation Procedures)をシステムに符号化し、アセンブリライン方式で各エージェントに特定の役割を割り当てることで実現される。 | Hong et al. (2023) |

| CAMEL | インセプション・プロンプティングと呼ばれる新手法を用い、会話型エージェントが人間の目的に整合したタスク達成へ向かうよう、エージェント間の自律的な協調を誘導する。 会話データの生成・研究のためのツールとしても機能し、コミュニケーションするエージェントのふるまいや相互作用の理解を助ける。 | Li et al. (2023) |

| Autogen | 言語モデルを用いたアプリケーションを作成できる汎用フレームワーク。 高いカスタマイズ性が特徴で、自然言語とコードの双方でエージェントの相互作用の仕方を記述できる。 コーディングや数学といった技術分野から、エンタメのような消費者向け分野まで、幅広く利用可能である。 | Wu et al. (2023) |

インセプション・プロンプティングとは、最初のプロンプトで役割・目的・会話ルールをエージェント同士に植え付け、その後はAIユーザ役がAIアシスタント役に指示を出し続ける形で、人手なしでも対話を自走させてタスクを進めるやり方です。

6. 課題

LLM-MAフレームワークと応用に関する研究は急速に進展している一方、多くの課題が残っています。ここでは、重要な5つの課題を指摘します。

| マルチモーダル環境への展開 | 既存研究の多くはテキスト中心の環境に焦点が当たっている。マルチモーダル(画像・音声・動画・物理行動など)設定に関する研究は不足している。 |

|---|---|

| マルチモーダル環境への展開 | 既存研究の多くはテキスト中心の環境に焦点が当たっている。マルチモーダル(画像・音声・動画・物理行動など)設定に関する研究は不足している。 |

| ハルシネーションへの対応 | マルチエージェント設定では、1つのエージェントのハルシネーションが連鎖的に波及し得るため、問題はさらに複雑になる。すなわち、ネットワーク内で誤情報が他のエージェントに受け入れられ、さらに伝播してしまう可能性がある。 |

| 集合知の獲得 | LLM-MAは主に、環境や人間との相互作用といった即時フィードバックから学習する。この学習様式には信頼できる対話型環境が必要だが、多くのタスクでその設計は難しく、スケーラビリティを制約しうる。 さらに、現在主流の記憶や自己進化による能力獲得手法では、各エージェントを個別に調整するが、ネットワーク全体の集合知を十分に引き出してはいない。 |

| LLM-MAシステムのスケーリング | LLM-MAは多数のLLMエージェントで構成されるため、エージェント数の増大に伴う計算資源の問題が大きい。各エージェントは高い処理能力とメモリを要するため、エージェント数を増やすと必要な計算資源が急増し、開発が難しくなる。 |

| 評価とベンチマーキング | 現時点のLLM-MAのデータセットとベンチマークは包括的とは言い難い。 既存研究の多くは狭い設定における個別エージェントの理解・推論の評価に偏り、マルチエージェントに固有のより広範で複雑な創発的行動を見落としがちである。 |

おわりに

本記事では、参考論文「Large Language Model based Multi-Agents: A Survey of Progress and Challenges」をもとに、LLM-MAをシステム設計の4要素と応用分野の2系に分けて概観しました。 LLM-MAは、シングルエージェントではできないエージェント間の相互作用を通じて、より複雑で動的なタスクに取り組むことができます。現在も多様な分野に応用されており、今後も活用の幅は広がっていくことが期待されます。 読者の皆様がLLM-MAを理解し、業務に活用する際の助けになれば幸いです。